联系我们: 010-82378600, 13911129392

未系安全带智能(néng)检测系统与深度学习技術(shù)介绍

未系安全带智能(néng)检测系统与深度学习介绍

未系安全带智能(néng)检测技術(shù)近年(nián)来高速发展,主要(yào)得益于深度学习前沿技術(shù)的快(kuài)速发展,明(míng)景未系安全带智能(néng)检测系统基于深度学习技術(shù),通(tōng)过海(hǎi)量车辆數(shù)据进行(xíng)反复迭代学习,才达到很(hěn)高的准确率。為(wèi)让大家对于明(míng)景未系安全带智能(néng)检测系统的技術(shù)方案及产品未来发展有个更全面的了(le)解,特此收集李汉曦博士对于深度学习技術(shù)的讲解,供大家学习了(le)解。

作(zuò)者:

李汉曦,慧眼科技研发总监,澳大利亚國(guó)立大学博士;曾任澳大利亚國(guó)家信息通(tōng)信公司(NICTA)任高级研究員(yuán);人(rén)脸识别,物(wù)体检测,物(wù)体跟踪、深度学习方面的专家,在TPAMI,TIP, TNNLS和(hé)Pattern Recognition等权威期刊,以及CVPR,ECCV,BMVC, ACCV等领域內(nèi)重要(yào)会議(yì)发表过有影响力的论文;现為(wèi)澳大利亚格里菲斯大学客座研究員(yuán),江西(xī)師(shī)范大学特聘教授。

人(rén)工(gōng)智能(néng)是人(rén)类一(yī)个非常美好的梦想,跟星际漫游和(hé)長(cháng)生不老(lǎo)一(yī)样。我们想制造出一(yī)种机器,使得它跟人(rén)一(yī)样具有一(yī)定的对外(wài)界事物(wù)感知能(néng)力,比如(rú)看(kàn)見(jiàn)世界。

在上(shàng)世纪50年(nián)代,數(shù)学家图灵提出判断机器是否具有人(rén)工(gōng)智能(néng)的标准:图灵测试。即把机器放在一(yī)个房間(jiān),人(rén)类测试員(yuán)在另一(yī)个房間(jiān),人(rén)跟机器聊天,测试員(yuán)事先不知道(dào)另一(yī)房間(jiān)里是人(rén)还是机器 。经过聊天,如(rú)果测试員(yuán)不能(néng)确定跟他(tā)聊天的是人(rén)还是机器的话,那(nà)么图灵测试就通(tōng)过了(le),也就是说這(zhè)个机器具有与人(rén)一(yī)样的感知能(néng)力。

但(dàn)是從(cóng)图灵测试提出来開(kāi)始到本世纪初,50多年(nián)時(shí)間(jiān)有无數(shù)科学家提出很(hěn)多机器学习的算法,试图让计算机具有与人(rén)一(yī)样的智力水平,但(dàn)直到2006年(nián)深度学习算法的成功,才带来了(le)一(yī)丝解决的希望。

众星捧月的深度学习

深度学习在很(hěn)多学術(shù)领域,比非深度学习算法往往有20-30%成绩的提高。很(hěn)多大公司也逐渐開(kāi)始出手投资這(zhè)种算法,并成立自(zì)己的深度学习团队,其中投入最大的就是谷歌(gē),2008年(nián)6月披露了(le)谷歌(gē)脑项目。2014年(nián)1月谷歌(gē)收购DeepMind,然后2016年(nián)3月其開(kāi)发的Alphago算法在围棋挑战赛中,战胜了(le)韩國(guó)九段棋手李世石,证明(míng)深度学习设计出的算法可(kě)以战胜這(zhè)个世界上(shàng)最强的选手。

在硬件方面,Nvidia最開(kāi)始做(zuò)显示芯片,但(dàn)從(cóng)2006及2007年(nián)開(kāi)始主推用GPU芯片进行(xíng)通(tōng)用计算,它特别适合深度学习中大量简单重复的计算量。目前很(hěn)多人(rén)选择Nvidia的CUDA工(gōng)具包进行(xíng)深度学习软件的開(kāi)发。

微(wēi)软從(cóng)2012年(nián)開(kāi)始,利用深度学习进行(xíng)机器翻译和(hé)中文语音合成工(gōng)作(zuò),其人(rén)工(gōng)智能(néng)小娜背后就是一(yī)套自(zì)然语言处理和(hé)语音识别的數(shù)据算法。

百度在2013年(nián)宣布成立百度研究院,其中最重要(yào)的就是百度深度学习研究所。

Facebook和(hé)Twitter也都(dōu)各自(zì)进行(xíng)了(le)深度学习研究,其中前者携手纽约大学教授Yann Lecun,建立了(le)自(zì)己的深度学习算法实验室;2015年(nián)10月,Facebook宣布開(kāi)源其深度学习算法框架,即Torch框架。Twitter在2014年(nián)7月收购了(le)Madbits,為(wèi)用户提供高精度的图像检索服务。

前深度学习時(shí)代的计算机視(shì)觉

互联网巨头看(kàn)重深度学习当然不是為(wèi)了(le)学術(shù),主要(yào)是它能(néng)带来巨大的市场。那(nà)為(wèi)什么在深度学习出来之前,传统算法為(wèi)什么没有达到深度学习的精度?

在深度学习算法出来之前,对于視(shì)觉算法来说,大致可(kě)以分為(wèi)以下(xià)5个步骤:特征感知,图像预处理,特征提取,特征筛选,推理预测与识别。早期的机器学习中,占优势的统计机器学习群体中,对特征是不大关心的。

我认為(wèi),计算机視(shì)觉可(kě)以说是机器学习在視(shì)觉领域的应用,所以计算机視(shì)觉在采用這(zhè)些机器学习方法的時(shí)候,不得不自(zì)己设计前面4个部分。

但(dàn)对任何人(rén)来说這(zhè)都(dōu)是一(yī)个比较难的任务。传统的计算机识别方法把特征提取和(hé)分类器设计分開(kāi)来做(zuò),然后在应用時(shí)再合在一(yī)起,比如(rú)如(rú)果输入是一(yī)个摩托车图像的话,首先要(yào)有一(yī)个特征表达或者特征提取的过程,然后把表达出来的特征放到学习算法中进行(xíng)分类的学习。

过去20年(nián)中出现了(le)不少(shǎo)优秀的特征算子,比如(rú)最著名的SIFT算子,即所谓的对尺度旋转保持不变的算子。它被广泛地(dì)应用在图像比对,特别是所谓的structure from motion這(zhè)些应用中,有一(yī)些成功的应用例子。另一(yī)个是HoG算子,它可(kě)以提取物(wù)体,比较鲁棒的物(wù)体边缘,在物(wù)体检测中扮演着重要(yào)的角色。

這(zhè)些算子还包括Textons,Spin image,RIFT和(hé)GLOH,都(dōu)是在深度学习诞生之前或者深度学习真正的流行(xíng)起来之前,占领視(shì)觉算法的主流。

几个(半)成功例子

這(zhè)些特征和(hé)一(yī)些特定的分类器组合取得了(le)一(yī)些成功或半成功的例子,基本达到了(le)商业化的要(yào)求但(dàn)还没有完全商业化。

一(yī)是八九十年(nián)代的指纹识别算法,它已经非常成熟,一(yī)般是在指纹的图案上(shàng)面去寻找一(yī)些关键点,寻找具有特殊几何特征的点,然后把两个指纹的关键点进行(xíng)比对,判断是否匹配。

然后是2001年(nián)基于Haar的人(rén)脸检测算法,在当時(shí)的硬件条件下(xià)已经能(néng)够达到实時(shí)人(rén)脸检测,我们现在所有手机相机里的人(rén)脸检测,都(dōu)是基于它或者它的变种。

第三个是基于HoG特征的物(wù)体检测,它和(hé)所对应的SVM分类器组合起来的就是著名的DPM算法。DPM算法在物(wù)体检测上(shàng)超过了(le)所有的算法,取得了(le)比较不错的成绩。

但(dàn)這(zhè)种成功例子太少(shǎo)了(le),因為(wèi)手工(gōng)设计特征需要(yào)大量的经验,需要(yào)你对這(zhè)个领域和(hé)數(shù)据特别了(le)解,然后设计出来特征还需要(yào)大量的调试工(gōng)作(zuò)。说白了(le)就是需要(yào)一(yī)点运气。

另一(yī)个难点在于,你不只需要(yào)手工(gōng)设计特征,还要(yào)在此基础上(shàng)有一(yī)个比较合适的分类器算法。同時(shí)设计特征然后选择一(yī)个分类器,這(zhè)两者合并达到最优的效果,几乎是不可(kě)能(néng)完成的任务。

仿生学角度看(kàn)深度学习

如(rú)果不手动设计特征,不挑选分类器,有没有别的方案呢?能(néng)不能(néng)同時(shí)学习特征和(hé)分类器?即输入某一(yī)个模型的時(shí)候,输入只是图片,输出就是它自(zì)己的标签。比如(rú)输入一(yī)个明(míng)星的头像,出来的标签就是一(yī)个50维的向量(如(rú)果要(yào)在50个人(rén)里识别的话),其中对应明(míng)星的向量是1,其他(tā)的位置是0。

這(zhè)种设定符合人(rén)类脑科学的研究成果。

1981年(nián)诺贝尔醫(yī)学生理学奖颁发给了(le)David Hubel,一(yī)位神经生物(wù)学家。他(tā)的主要(yào)研究成果是发现了(le)視(shì)觉系统信息处理机制,证明(míng)大脑的可(kě)視(shì)皮层是分级的。他(tā)的贡献主要(yào)有两个,一(yī)是他(tā)认為(wèi)人(rén)的視(shì)觉功能(néng)一(yī)个是抽象,一(yī)个是迭代。抽象就是把非常具体的形象的元素,即原始的光(guāng)线像素等信息,抽象出来形成有意义的概念。這(zhè)些有意义的概念又会往上(shàng)迭代,变成更加抽象,人(rén)可(kě)以感知到的抽象概念。

像素是没有抽象意义的,但(dàn)人(rén)脑可(kě)以把這(zhè)些像素连接成边缘,边缘相对像素来说就变成了(le)比较抽象的概念;边缘进而形成球形,球形然后到气球,又是一(yī)个抽象的过程,大脑最终就知道(dào)看(kàn)到的是一(yī)个气球。

模拟人(rén)脑识别人(rén)脸,也是抽象迭代的过程,從(cóng)最開(kāi)始的像素到第二层的边缘,再到人(rén)脸的部分,然后到整张人(rén)脸,是一(yī)个抽象迭代的过程。

再比如(rú)看(kàn)到图片中的摩托车,我们可(kě)能(néng)在脑子里就几微(wēi)秒的時(shí)間(jiān),但(dàn)是经过了(le)大量的神经元抽象迭代。对计算机来说最開(kāi)始看(kàn)到的根本也不是摩托车,而是RGB图像三个通(tōng)道(dào)上(shàng)不同的數(shù)字。

所谓的特征或者視(shì)觉特征,就是把這(zhè)些數(shù)值给综合起来用统计或非统计的形式,把摩托车的部件或者整辆摩托车表现出来。深度学习的流行(xíng)之前,大部分的设计图像特征就是基于此,即把一(yī)个區(qū)域內(nèi)的像素级别的信息综合表现出来,利于后面的分类学习。

如(rú)果要(yào)完全模拟人(rén)脑,我们也要(yào)模拟抽象和(hé)递归迭代的过程,把信息從(cóng)最细琐的像素级别,抽象到“种类”的概念,让人(rén)能(néng)够接受。

卷积的概念

计算机視(shì)觉里经常使卷积神经网络,即CNN,是一(yī)种对人(rén)脑比较精准的模拟。

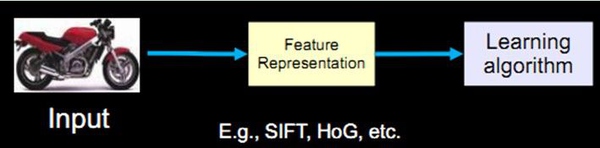

什么是卷积?卷积就是两个函數(shù)之間(jiān)的相互关系,然后得出一(yī)个新的值,他(tā)是在连续空間(jiān)做(zuò)积分计算,然后在离散空間(jiān)內(nèi)求和(hé)的过程。实际上(shàng)在计算机視(shì)觉里面,可(kě)以把卷积当做(zuò)一(yī)个抽象的过程,就是把小區(qū)域內(nèi)的信息统计抽象出来。

比如(rú),对于一(yī)张爱因斯坦的照片,我可(kě)以学习n个不同的卷积和(hé)函數(shù),然后对這(zhè)个區(qū)域进行(xíng)统计。可(kě)以用不同的方法统计,比如(rú)着重统计中央,也可(kě)以着重统计周围,這(zhè)就导致统计的和(hé)函數(shù)的种类多种多样,為(wèi)了(le)达到可(kě)以同時(shí)学习多个统计的累积和(hé)。

上(shàng)图中是,如(rú)何從(cóng)输入图像怎么到最后的卷积,生成的响应map。首先用学习好的卷积和(hé)对图像进行(xíng)扫描,然后每一(yī)个卷积和(hé)会生成一(yī)个扫描的响应图,我们叫response map,或者叫feature map。如(rú)果有多个卷积和(hé),就有多个feature map。也就说從(cóng)一(yī)个最開(kāi)始的输入图像(RGB三个通(tōng)道(dào))可(kě)以得到256个通(tōng)道(dào)的feature map,因為(wèi)有256个卷积和(hé),每个卷积和(hé)代表一(yī)种统计抽象的方式。

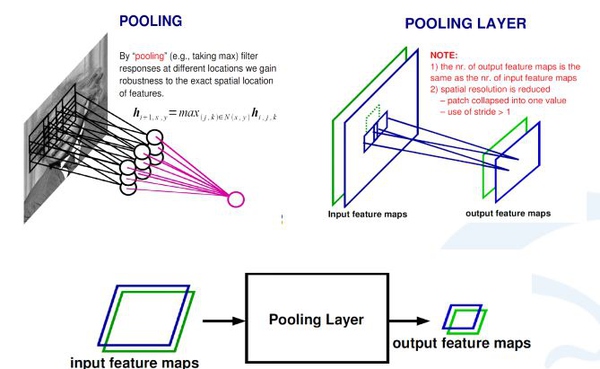

在卷积神经网络中,除了(le)卷积层,还有一(yī)种叫池化的操作(zuò)。池化操作(zuò)在统计上(shàng)的概念更明(míng)确,就是一(yī)个对一(yī)个小區(qū)域內(nèi)求平均值或者求最大值的统计操作(zuò)。

带来的结果是,如(rú)果之前我输入有两个通(tōng)道(dào)的,或者256通(tōng)道(dào)的卷积的响应feature map,每一(yī)个feature map都(dōu)经过一(yī)个求最大的一(yī)个池化层,会得到一(yī)个比原来feature map更小的256的feature map。

在上(shàng)面這(zhè)个例子里,池化层对每一(yī)个2X2的區(qū)域求最大值,然后把最大值赋给生成的feature map的对应位置。如(rú)果输入图像是100×100的话,那(nà)输出图像就会变成50×50,feature map变成了(le)一(yī)半。同時(shí)保留的信息是原来2X2區(qū)域里面最大的信息。

操作(zuò)的实例:LeNet网络

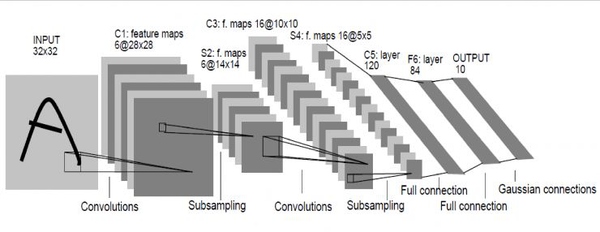

Le顾名思义就是指人(rén)工(gōng)智能(néng)领域的大牛Yann Lecun。這(zhè)个网络是深度学习网络的最初原型,因為(wèi)之前的网络都(dōu)比较浅,它较深的。LeNet在98年(nián)就发明(míng)出来了(le),当時(shí)Lecun在AT&T的实验室,他(tā)用這(zhè)一(yī)网络进行(xíng)字母识别,达到了(le)非常好的效果。

怎么构成呢?输入图像是32×32的灰度图,第一(yī)层经过了(le)一(yī)组卷积和(hé),生成了(le)6个28X28的feature map,然后经过一(yī)个池化层,得到得到6个14X14的feature map,然后再经过一(yī)个卷积层,生成了(le)16个10X10的卷积层,再经过池化层生成16个5×5的feature map。

從(cóng)最后16个5X5的feature map開(kāi)始,经过了(le)3个全连接层,达到最后的输出,输出就是标签空間(jiān)的输出。由于设计的是只要(yào)对0到9进行(xíng)识别,所以输出空間(jiān)是10,如(rú)果要(yào)对10个數(shù)字再加上(shàng)26个大小字母进行(xíng)识别的话,输出空間(jiān)就是62。62维向量里,如(rú)果某一(yī)个维度上(shàng)的值最大,它对应的那(nà)个字母和(hé)數(shù)字就是就是预测结果。

压在骆驼身上(shàng)的最后一(yī)根稻草

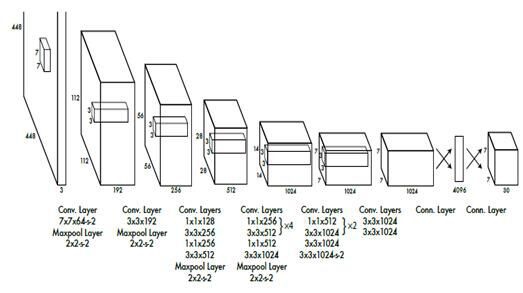

從(cóng)98年(nián)到本世纪初,深度学习兴盛起来用了(le)15年(nián),但(dàn)当時(shí)成果泛善可(kě)陈,一(yī)度被边缘化。到2012年(nián),深度学习算法在部分领域取得不错的成绩,而压在骆驼身上(shàng)最后一(yī)根稻草就是AlexNet。

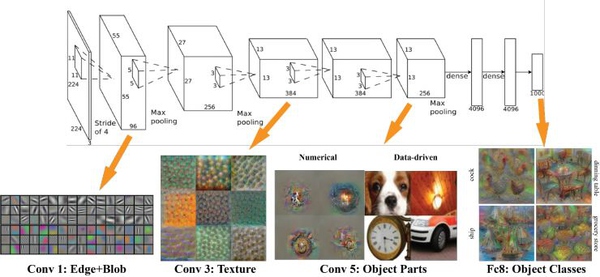

AlexNet由多伦多大学几个科学家開(kāi)发,在ImageNet比赛上(shàng)做(zuò)到了(le)非常好的效果。当時(shí)AlexNet识别效果超过了(le)所有浅层的方法。此后,大家认识到深度学习的時(shí)代终于来了(le),并有人(rén)用它做(zuò)其它的应用,同時(shí)也有些人(rén)開(kāi)始開(kāi)发新的网络结构。

其实AlexNet的结构也很(hěn)简单,只是LeNet的放大版。输入是一(yī)个224X224的图片,是经过了(le)若干个卷积层,若干个池化层,最后连接了(le)两个全连接层,达到了(le)最后的标签空間(jiān)。

去年(nián),有些人(rén)研究出来怎么样可(kě)視(shì)化深度学习出来的特征。那(nà)么,AlexNet学习出的特征是什么样子?在第一(yī)层,都(dōu)是一(yī)些填充的块状物(wù)和(hé)边界等特征;中間(jiān)的层開(kāi)始学习一(yī)些纹理特征;更高接近分类器的层级,则可(kě)以明(míng)显看(kàn)到的物(wù)体形状的特征。

最后的一(yī)层,即分类层,完全是物(wù)体的不同的姿态,根据不同的物(wù)体展现出不同姿态的特征了(le)。

可(kě)以说,不论是对人(rén)脸,车辆,大象或椅子进行(xíng)识别,最開(kāi)始学到的东西(xī)都(dōu)是边缘,继而就是物(wù)体的部分,然后在更高层层级才能(néng)抽象到物(wù)体的整体。整个卷积神经网络在模拟人(rén)的抽象和(hé)迭代的过程。

為(wèi)什么時(shí)隔20年(nián)卷土(tǔ)重来?

我们不禁要(yào)問(wèn):似乎卷积神经网络设计也不是很(hěn)复雜(zá),98年(nián)就已经有一(yī)个比较像样的雏形了(le)。自(zì)由换算法和(hé)理论证明(míng)也没有太多进展。那(nà)為(wèi)什么時(shí)隔20年(nián),卷积神经网络才能(néng)卷土(tǔ)重来,占领主流?

這(zhè)一(yī)問(wèn)题与卷积神经网络本身的技術(shù)关系不太大,我个人(rén)认為(wèi)与其他(tā)一(yī)些客观因素有关。

首先,卷积神经网络的深度太浅的话,识别能(néng)力往往不如(rú)一(yī)般的浅层模型,比如(rú)SVM或者boosting。但(dàn)如(rú)果做(zuò)得很(hěn)深,就需要(yào)大量數(shù)据进行(xíng)训练,否则机器学习中的过拟合将不可(kě)避免。而2006及2007年(nián)開(kāi)始,正好是互联网開(kāi)始大量产生各种各样的图片數(shù)据的時(shí)候。

另外(wài)一(yī)个条件是运算能(néng)力。卷积神经网络对计算机的运算要(yào)求比较高,需要(yào)大量重复可(kě)并行(xíng)化的计算,在当時(shí)CPU只有单核且运算能(néng)力比较低(dī)的情况下(xià),不可(kě)能(néng)进行(xíng)个很(hěn)深的卷积神经网络的训练。随着GPU计算能(néng)力的增長(cháng),卷积神经网络结合大數(shù)据的训练才成為(wèi)可(kě)能(néng)。

最后一(yī)点就是人(rén)和(hé)。卷积神经网络有一(yī)批一(yī)直在坚持的科学家(如(rú)Lecun)才没有被沉默,才没有被海(hǎi)量的浅层方法淹没。然后最后终于看(kàn)到卷积神经网络占领主流的曙光(guāng)。

深度学习在視(shì)觉上(shàng)的应用

计算机視(shì)觉中比较成功的深度学习的应用,包括人(rén)脸识别,图像問(wèn)答(dá),物(wù)体检测,物(wù)体跟踪。

人(rén)脸识别:

這(zhè)里说人(rén)脸识别中的人(rén)脸比对,即得到一(yī)张人(rén)脸,与數(shù)据库里的人(rén)脸进行(xíng)比对;或同時(shí)给两张人(rén)脸,判断是不是同一(yī)个人(rén)。

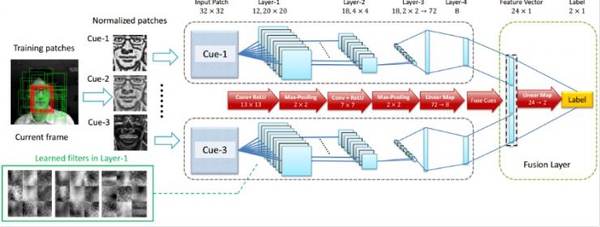

這(zhè)方面比较超前的是汤晓鸥教授,他(tā)们提出的DeepID算法在LWF上(shàng)做(zuò)得比较好。他(tā)们也是用卷积神经网络,但(dàn)在做(zuò)比对時(shí),两张人(rén)脸分别提取了(le)不同位置特征,然后再进行(xíng)互相比对,得到最后的比对结果。最新的DeepID-3算法,在LWF达到了(le)99.53%准确度,与肉眼识别结果相差无几。

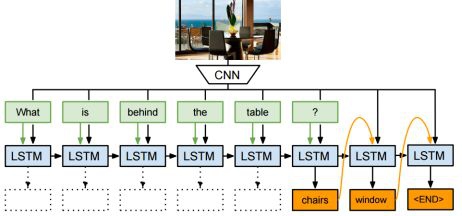

图片問(wèn)答(dá)問(wèn)题:

這(zhè)是2014年(nián)左右兴起的课题,即给张图片同時(shí)問(wèn)个問(wèn)题,然后让计算机回答(dá)。比如(rú)有一(yī)个办公室靠海(hǎi)的图片,然后問(wèn)“桌子后面有什么”,神经网络输出应该是“椅子和(hé)窗户”。

這(zhè)一(yī)应用引入了(le)LSTM网络,這(zhè)是一(yī)个专门设计出来具有一(yī)定记忆能(néng)力的神经单元。特点是,会把某一(yī)个時(shí)刻的输出当作(zuò)下(xià)一(yī)个時(shí)刻的输入。可(kě)以认為(wèi)它比较适合语言等,有時(shí)間(jiān)序列关系的场景。因為(wèi)我们在读一(yī)篇文章(zhāng)和(hé)句子的時(shí)候,对句子后面的理解是基于前面对词语的记忆。

图像問(wèn)答(dá)問(wèn)题是基于卷积神经网络和(hé)LSTM单元的结合,来实现图像問(wèn)答(dá)。LSTM输出就应该是想要(yào)的答(dá)案,而输入的就是上(shàng)一(yī)个時(shí)刻的输入,以及图像的特征,及問(wèn)句的每个词语。

物(wù)体检测問(wèn)题:

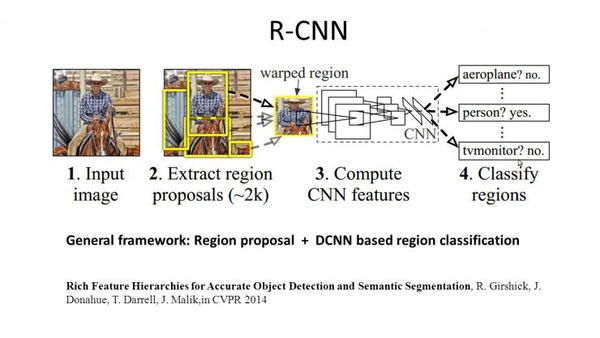

Region CNN

深度学习在物(wù)体检测方面也取得了(le)非常好的成果。2014年(nián)的Region CNN算法,基本思想是首先用一(yī)个非深度的方法,在图像中提取可(kě)能(néng)是物(wù)体的图形块,然后深度学习算法根据這(zhè)些图像块,判断属性和(hé)一(yī)个具体物(wù)体的位置。

為(wèi)什么要(yào)用非深度的方法先提取可(kě)能(néng)的图像块?因為(wèi)在做(zuò)物(wù)体检测的時(shí)候,如(rú)果你用扫描窗的方法进行(xíng)物(wù)体监测,要(yào)考虑到扫描窗大小的不一(yī)样,長(cháng)宽比和(hé)位置不一(yī)样,如(rú)果每一(yī)个图像块都(dōu)要(yào)过一(yī)遍深度网络的话,這(zhè)种時(shí)間(jiān)是你无法接受的。

所以用了(le)一(yī)个折中的方法,叫Selective Search。先把完全不可(kě)能(néng)是物(wù)体的图像块去除,只剩2000左右的图像块放到深度网络里面判断。那(nà)么取得的成绩是AP是58.5,比以往几乎翻了(le)一(yī)倍。有一(yī)点不尽如(rú)人(rén)意的是,region CNN的速度非常慢(màn),需要(yào)10到45秒处理一(yī)张图片。

Faster R-CNN方法

而且我在去年(nián)NIPS上(shàng),我们看(kàn)到的有Faster R-CNN方法,一(yī)个超级加速版R-CNN方法。它的速度达到了(le)每秒七帧,即一(yī)秒鐘(zhōng)可(kě)以处理七张图片。技巧在于,不是用图像块来判断是物(wù)体还是背景,而把整张图像一(yī)起扔进深度网络里,让深度网络自(zì)行(xíng)判断哪里有物(wù)体,物(wù)体的方块在哪里,种类是什么?

经过深度网络运算的次數(shù)從(cóng)原来的2000次降到一(yī)次,速度大大提高了(le)。

Faster R-CNN提出了(le)让深度学习自(zì)己生成可(kě)能(néng)的物(wù)体块,再用同样深度网络来判断物(wù)体块是否是背景?同時(shí)进行(xíng)分类,还要(yào)把边界和(hé)给估计出来。

Faster R-CNN可(kě)以做(zuò)到又快(kuài)又好,在VOC2007上(shàng)检测AP达到73.2,速度也提高了(le)两三百倍。

YOLO

去年(nián)FACEBOOK提出来的YOLO网络,也是进行(xíng)物(wù)体检测,最快(kuài)达到每秒鐘(zhōng)155帧,达到了(le)完全实時(shí)。它让一(yī)整张图像进入到神经网络,让神经网络自(zì)己判断這(zhè)物(wù)体可(kě)能(néng)在哪里,可(kě)能(néng)是什么。但(dàn)它缩减了(le)可(kě)能(néng)图像块的个數(shù),從(cóng)原来Faster R-CNN的2000多个缩减缩减到了(le)98个。

同時(shí)取消了(le)Faster R-CNN里面的RPN结构,代替Selective Search结构。YOLO里面没有RPN這(zhè)一(yī)步,而是直接预测物(wù)体的种类和(hé)位置。

YOLO的代价就是精度下(xià)降,在155帧的速度下(xià)精度只有52.7,45帧每秒時(shí)的精度是63.4。

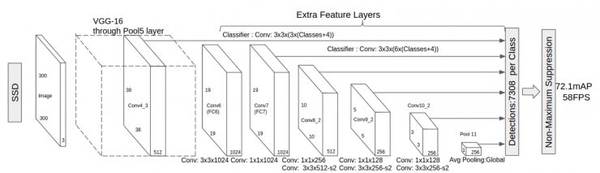

SSD

在arXiv上(shàng)出现的最新算法叫Single Shot MultiBox Detector,即SSD。

它是YOLO的超级改进版,吸取了(le)YOLO的精度下(xià)降的教训,同時(shí)保留速度快(kuài)的特点。它能(néng)达到58帧每秒,精度有72.1。速度超过Faster R-CNN 有8倍,但(dàn)达到类似的精度。

物(wù)体跟踪

所谓跟踪,就是在視(shì)頻(pín)里面第一(yī)帧時(shí)锁定感兴趣的物(wù)体,让计算机跟着走,不管怎么旋转晃动,甚至躲在樹(shù)丛后面也要(yào)跟踪。

深度学习对跟踪問(wèn)题有很(hěn)显著的效果。DeepTrack算法是我在澳大利亚信息科技研究院時(shí)和(hé)同事提出的,是第一(yī)在线用深度学习进行(xíng)跟踪的文章(zhāng),当時(shí)超过了(le)其它所有的浅层算法。

今年(nián)有越来越多深度学习跟踪算法提出。去年(nián)十二月ICCV 2015上(shàng)面,马超提出的Hierarchical Convolutional Feature算法,在數(shù)据上(shàng)达到最新的记录。它不是在线更新一(yī)个深度学习网络,而是用一(yī)个大网络进行(xíng)预训练,然后让大网络知道(dào)什么是物(wù)体什么不是物(wù)体。

将大网络放在跟踪視(shì)頻(pín)上(shàng)面,然后再分析网络在視(shì)頻(pín)上(shàng)产生的不同特征,用比较成熟的浅层跟踪算法来进行(xíng)跟踪,這(zhè)样利用了(le)深度学习特征学习比较好的好处,同時(shí)又利用了(le)浅层方法速度较快(kuài)的优点。效果是每秒鐘(zhōng)10帧,同時(shí)精度破了(le)记录。

最新的跟踪成果是基于Hierarchical Convolutional Feature,由一(yī)个韩國(guó)的科研组提出的MDnet。它集合了(le)前面两种深度算法的集大成,首先离线的時(shí)候有学习,学习的不是一(yī)般的物(wù)体检测,也不是ImageNet,学习的是跟踪視(shì)頻(pín),然后在学习視(shì)頻(pín)结束后,在真正在使用网络的時(shí)候更新网络的一(yī)部分。這(zhè)样既在离线的時(shí)候得到了(le)大量的训练,在线的時(shí)候又能(néng)够很(hěn)灵活改变自(zì)己的网络。